1 Hadoop安装下载解压配置环境变量搭建hadoop集群,检查安装2 集群配置与说明添加快照,配置文件路径与内容,初始化HDFS namenode3 启动集群添加用户定义,启动dfs与yarn,确认集群正常运行本文详细介绍了从虚拟机安装到Hadoop集群配置的全过程,旨在帮助新手快速上手,确保搭建过程顺利无误从虚拟机配置到SSH连接,再到Hadoop的安装与集群配。

原因SSH无密码登录可能是在一个用户下配置的,而Hadoop集群可能是在另一个用户下搭建和启动的这种情况下,尽管SSH本身配置无误,但由于用户不一致,Hadoop启动过程中仍然会要求输入密码解决方案确保Hadoop集群的搭建和启动都是在同一个已经配置好SSH无密码登录的用户下进行节点间配置不一致原因。

为了搭建集群,首先拉取BitNami的Spark和Hadoop镜像创建一个工作目录并在该目录下编写Docker Compose配置文件以启动集群,使用该配置文件后,通过执行命令启动Spark Docker集群集群的网络默认使用桥接网络,名为spark_default,该网络使用相同的子网网段,使得集群内容器可以相互通信检查网络配置详情,可以查看。

NodeManager运行在集群节点上的代理,负责管理节点上的资源,并启动监控容器在Spark中,一个Executor就是YARN的一个容器Application在每个Spark应用程序中有一个Application实例,负责向ResourceManager请求资源分配任务监控任务的执行,并与NodeManager通信以启动Executor四总结 整个方案使用Hadoop的。

继续调整Hadoop配置文件创建目录,修改配置文件完成Hadoop等配置,导出镜像并创建容器启动集群并测试Hadoop功能搭建具有三个节点的集群,其中一台作为主节点,其余两台作为从节点配置集群间SSH免密码登录修改Hadoop配置文件以适应集群环境启动Hadoop集群,配置分发集群配置文件,启动集群并测试。

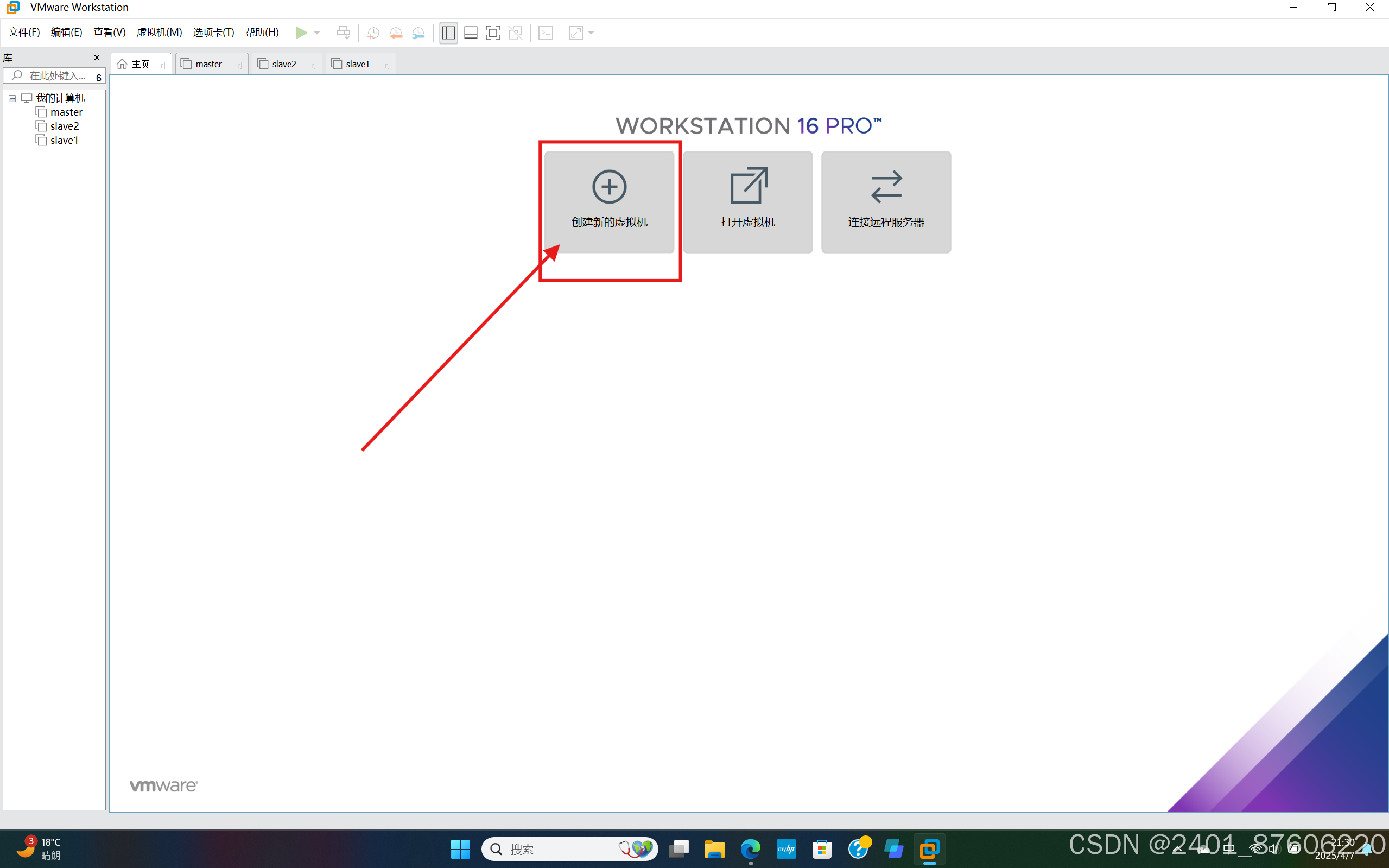

本文通过在vmware workstation上建立三台虚拟机来搭建hadoop集群环境,其中一台作为namenode,两台作为datanode一安装vmware workstation1000一路下一步即可二创建3个虚拟机 每个虚拟机安装Ubuntu 桌面版搭建hadoop集群我用的1110,但是有点老了,建议用1204或更高版本namenode建议多给写内存。

导出包含Hadoop环境的镜像使用该镜像创建容器,并启动Hadoop集群测试Hadoop集群访问集群状态页面以检查集群状态浏览HDFS文件以验证HDFS功能使用Python访问Hadoop集群编写Python脚本,利用Hadoop提供的API或命令行工具与集群进行交互搭建多节点集群重复上述步骤,为每个节点构建并启动容器配置集群间的。

在Linux或Unix操作系统中,所有的程序文件都有权限设定,若遇到只读文件,那么就无法对其进行编辑操作那么如何才能更改只读文件,让其具备写操作呢笔者建议按以下步骤进行在hadoop配置目录下通过命令ls l hadoopenv查看hadoopenv 当前的具有的权限项,若显示行开头是r或者rx,那么就表明所属文件无法。

Puppet是UnixLinux下的一个自动化管理引擎,它能基于一个集中式的配置执行增加用户安装软件包更新服务器配置等管理任务搭建hadoop集群我们将主要讲解如何利用Yum和Puppet来安装Hadoop利用YumPuppet搭建Hadoop集群 要利用Puppet搭建Hadoop集群,首先要符合以下前置条件包含所有必需Hadoop软件的中央仓库 用于Hadoop部署。

Hadoop集群环境搭建详细介绍Hadoop集群的搭建步骤配置参数以及集群管理技巧HDFS常用Shell命令列出并解释HDFS常用的Shell命令,方便读者进行文件操作和管理基于Zookeeper搭建Hadoop高可用集群讲解如何利用Zookeeper实现Hadoop集群的高可用性Spark Spark Core介绍Spark的核心概念架构以及运行原理Spark。

一 项目简介 GitHub kiwanlauhadoopclusterdocker 直接用机器搭建Hadoop集群是一个相当痛苦的过程,尤其对初学者来说他们还没开始跑wordcount,可能就被这个问题折腾的体无完肤了而且也不是每个人都有好几台机器对吧搭建hadoop集群你可以尝试用多个虚拟机搭建,前提是搭建hadoop集群你有个性能杠杠的机器我的目标是将。

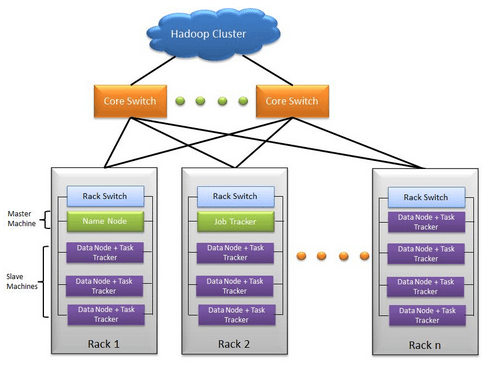

Hadoop的数据在集群上均衡分布,并通过复制副本来确保数据的可靠性和容错性因为数据和对数据处理的操作都是分布在服务器上,处理指令就可以直接地发送到存储数据的机器这样一个集群的每个服务器器上都需要存储和处理数据,因此必须对Hadoop集群的每个节点进行配置,以满足数据存储和处理要求Hadoop框架中。

重启集群后并发度提升,任务执行效率显著提高总结,通过本文详细阐述的Yarn集群搭建流程,包括环境准备组件安装配置管理与问题优化,能够实现Hadoop集群的高效运行与任务执行参考资源包括Hadoop Cluster Setup和如何搭建一个Hadoop集群 掘金,为深入理解集群架构与实际应用提供指南。

在大数据学习中,搭建HadoopSparkHive集群通常需要虚拟机环境,这耗时耗力,对配置要求较高,易导致电脑卡死Docker容器技术的出现提供了新的解决方案,它允许以轻量级方式部署这些组件本文将指导您如何在Docker中容器化部署HadoopSparkHive集群首先,安装Docker Desktop,确保在Windows系统中已删除。

主节点Master Node集群中的管理节点,负责分配任务和协调集群中各节点的工作工作节点Worker Node执行主节点分配的任务的节点,是集群中实际进行计算的单元集群管理软件用于管理集群配置资源分配和任务调度的软件,如HadoopSpark等集群搭建步骤需求分析明确集群的应用场景性能需求。

一个Hadoop集群的机器数量最少需要3个以下是具体原因ZooKeeper部署要求ZooKeeper是Hadoop生态系统中一个重要的组件,用于管理集群中的元数据为了保证ZooKeeper的高可用性和数据一致性,ZooKeeper建议最少安装在3个节点上,且节点数目通常为奇数HDFS高可用配置虽然理论上HDFS可以在单个节点上运行,但在。

Hadoop集群的作用及目的作用Hadoop集群主要用于处理大规模数据集它通过分布式存储HDFS和分布式计算MapReduce或YARN框架,将大型数据集分割成小块,并在集群中的多个节点上并行处理这样,即使面对海量数据,也能实现高效快速的分析和处理目的Hadoop集群的目的是提高数据处理能力,降低硬件。

相关标签 :

上一篇: nagios安装,nagios安装教程

微信医疗(登记+咨询+回访)预约管理系统

微信医疗(登记+咨询+回访)预约管理系统  云约CRM微信小程序APP系统定制开发

云约CRM微信小程序APP系统定制开发  云约CRM体检自定义出号预约管理系统

云约CRM体检自定义出号预约管理系统  云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统

云约CRM云诊所系统,云门诊,医疗预约音视频在线问诊预约系统  云约CRM新版美容微信预约系统门店版_门店预约管理系统

云约CRM新版美容微信预约系统门店版_门店预约管理系统 云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统

云约CRM最新ThinkPHP6通用行业的预约小程序(诊所挂号)系统联系电话:18300931024

在线QQ客服:616139763

官方微信:18300931024

官方邮箱: 616139763@qq.com